Por Rubén Chaia*

“LA IA COMO TESTIGO EXPERTO Y EL DERECHO A CONFRONTAR FUENTES DE CONOCIMIENTO NO HUMANAS”. REFLEXIONES EN PUNTO A LA NECESIDAD DE RECALCULAR EL DERECHO A CONFRONTACIÓN EN LA ERA DE LA IA

1. Irrupción de la IA en el proceso

En este aporte quiero hacer una reseña del tema que abordé en el XX Encuentro de Profesores de Derecho Procesal Penal realizado en la ciudad de Paraná, Entre Ríos, intentando poner en relieve la complejidad que implica el uso de la Inteligencia Artificial en el proceso penal; uso que en ocasiones y aún sin advertir, hacemos al introducir evidencia digital.

Inicialmente debo aclarar que la presentación no se refirió al uso de la IA para crear, alterar o manipular evidencias que luego se intenta introducir en el proceso más bien estuvo dirigida a plantear ciertos interrogantes que hacen al uso de la IA como testigo experto o bien, como juez en el ámbito de la justicia penal.

En esa línea me pregunté si la IA podría llegar a reemplazar a los abogados en su función de acusadores, defensores o jueces o bien, si podrían suplantar a los peritos o expertos en su labor de aportar claridad en temas técnico-científicos.

2. Prueba testimonial y no testimonial. Autenticación y acreditación como ejes de la admisión

En primer lugar, marque una línea divisoria entre prueba testimonial y no testimonial para luego, señalar que los filtros comunes que rigen la admisión de estas pruebas los marca la relevancia y legalidad en tanto, que por aplicación del principio de proporcionalidad deben resultar más probatorias que perjudiciales por ser inflamatorias, confusas, vagas o bien, inútiles por referirse a hechos notorios o acordados[1].

Desde ese punto sostuve que, una vez obtenido el pase a juicio, en ese ámbito, las pruebas testimoniales deben acreditarse en tanto que las no testimoniales -materiales o documentales- deben autenticarse. Si bien esto parece algo claro y simple, los litigantes suelen no distinguir estas actividades y tratar ambas pruebas de forma idéntica[2].

Postulé que no toda prueba material que se intenta introducir al proceso requiere de "cadena de custodia"; habrá algunas que pueden ser descriptas, identificadas y reconocidas y con ello, incorporadas y otras, sobre las que se necesitará establecer la trazabilidad e intangibilidad, para autenticarlas y permitir trabajar con ellas en el juicio[3].

Marqué la diferencia entre cadena de custodia y cadena de valor conceptos sobre los que debemos trabajar para evitar tratar a toda evidencia de la misma manera. Habrá algunas que requieran mayores recaudos, aquellas fungibles no identificables a simple vista sin dudas exigirán más trabajo a la hora de asegurar su identidad sin que la omisión de contar con una cadena de custodia o seguir un protocolo, implique, per se, la ineficacia probatoria de la evidencia. Validez y valor son vías paralelas que no deben ser fusionadas por el litigante[4].

3. Posibilidades y complejidades que presenta el uso de IA en el proceso penal

Señalada estas cuestiones generales ingrese al tema de la IA en sus diversas facetas en el ámbito del proceso penal. A modo de síntesis, entiendo que la IA puede ser utilizada como: a) soporte del litigante -búsqueda y selección de jurisprudencia, doctrina, control de escritos, testeo de alegatos, examen y contra, etc.-, b) evidencia para investigar e intentar probar un hecho -presentación de fotos, videos, o rastros de geolocalización, etc.-, c) opinión sobre comportamientos futuros -IA predictiva, COMPAS- d) ¿prueba conclusiva de los hechos? -solicitarle una pericia, un informe o una conclusión sobre determinadas evidencias-, e) ¿testigo experto? -requerirle un informe de parte, una opinión respecto de un tema debatido-, f) ¿juez de los hechos? -intentar que resuelva el tema, pedirle una conclusión en base a información aportada por las partes y generada por la propia IA-.

Notarán que algunas de las funciones que le asigné tienen signos de interrogación, ello se debe a que no lo expreso como afirmación sino como posibilidad máxime cuando tenemos en cuenta el debate que surgió en Estados Unidos con la prueba del polígrafo[5].

Ahora bien, es indudable que la IA vino para quedarse y puede facilitar la labor del abogado en la función que sea que le toque ejercer. Como litigante puede: a) mejorar sus habilidades, b) acelerar los tiempos, c) hacer análisis masivos de datos, d) recuperar archivos, e) conectar información en tiempo real, f) comparar imágenes y entornos, g) practicar cálculos, mediciones, síntesis, estadísticas, etc. Esas ventajas pueden ser útiles siempre y cuando se actúe con prudencia y con absoluta seriedad en la búsqueda de datos y su postulación.

Pero, por ahora, a la IA le faltará la empatía para comunicar, para convencer o persuadir; el llamado factor “humano” o emocional, tan importante en el discurso y que en la actualidad parece no contar con él.

Tampoco tiene, prima facie, los valores necesarios que deben componer la historia que se va a litigar en juicio a fin de evitar que se transforme en un prospecto de medicamento[6].

4. ¿La IA como testigo experto o perito?

En relación al trabajo pericial, si concretamente puede reemplazar al testigo experto o perito, podría decirse que actualmente la IA realiza una serie de operaciones que en ocasiones podemos -o creemos que podemos- controlar y en otras, no somos capaces de hacerlo.

Hace unos veinte años, las pericias eran una cuestión reservada para un tema puntual: una defraudación: pericial caligráfica, luego, con el ADN por ejemplo se extendió su uso sobre hechos y casos no resueltos, Legajos NN, rastros múltiples, investigaciones sobre personas diversas al sospechado, entre otros ampliando el espectro de investigación sobre hechos diversos o distantes al inicial; hoy la IA permite conectar miles de datos y personas generando información que puede transformar en sospechoso a un sujeto distante del sitio donde el crimen se cometió o bien, conectar a todo aquel que ha dejado rastros en el ecosistema digital, rastros que pueden ser seleccionados y utilizados en su contra aún sin que lo sepa. Es más, puede analizar predictivamente datos con el fin de establecer probables conductas delictivas futuras o, dotar a las fuerzas de seguridad de “causas probables” mediante el análisis probabilístico de datos.

Y esas operaciones, en general, no pueden ser totalmente controladas por las partes -entre otras cuestiones- por secreto comercial o de registro de patentes, por falta o limitación de conocimientos, por imposibilidad de ver o establecer sesgos. Esto me ha llevado a sostener que el derecho a confrontación como ha sido concebido, se debe reconfigurar a la luz de esta época[7].

5. IA y derecho a confrontar. Recalculando el “derecho a confrontar cara a cara”

No quiero dar una opinión concluyente sobre el tema que aún estoy investigando, sí tengo preguntas que me gustaría compartir las siguientes inquietudes / reflexiones:

a) Sobre el derecho a confrontar: ¿Tenemos derecho a confrontar contra el programa? o ¿contra la máquina?, en su caso, ¿qué garantías podríamos reclamar?. ¿Están en juego los principios de inmediación, confrontación, oralidad, publicidad, tan caros para el sistema Acusatorio?.

b) En relación a las operaciones técnicas: ¿qué podríamos discutir?, ¿si son reproducibles de modo confiable en un ambiente seguro?, ¿si pueden ser expuestas?.

c) En punto a la autoincriminación forzada: los temas que surgen son: ¿existe una protección sobre los datos o información que se confía a la IA en cada conversación -comunicación, interacción- que ejecuta el operador?, entiendo que no. ¿Pueden utilizarse en su contra las búsquedas, la información que obtuvo, las conclusiones u opiniones que buscó?, entiendo que sí. ¿surge la necesidad de regular esta cuestión?, entiendo que sí.

d) Autoincriminación no consentida: ¿se puede configurar una autoincriminación no consentida cuando se utiliza datos o información que el usuario emplea Apps, redes, etc.?, ¿puede surgir ese tipo de autoincriminación de datos que el usuario aporta para poder unirse a una red o Apps?, etc.

Bajo estos disparadores, está claro que debemos reconfigurar el derecho a no autoincriminación forzada tal cual indiqué más arriba, me pregunto si existe la posibilidad de una autoincriminación que no se entienda como forzada pero sí, que se considere no consentida y que sus efectos puedan analizarse bajo ciertas pautas incluso, en el marco de protocolos o regulaciones que objetiven el tratamiento de rastros.

e) Conclusión provisoria: ¿Existe un derecho a confrontar fuentes de conocimiento no humanas? Esto me lleva a concluir que debemos trabajar en repensar el derecho a confrontación introduciendo quizás una ampliación y reformulación respecto del uso de la IA en el proceso penal y las posibles implicancias que ello acarrea en orden al sujeto sospechado, a la víctima y los demás involucrados incluso, respecto de terceros.

Se podría decir entonces que ¿existe un derecho a confrontar a fuentes de conocimiento no humanas?. En algún punto creo que sí.

Para ello debemos definir sesgos, margen de error, opacidad entre otras cuestiones fundamentales. Distinguir confrontación de validación y validación de confiabilidad es central en el nuevo esquema, entre otras variables.

6. ¿La IA como testigo experto y el perito como su vocero?

Desde la lógica del proceso penal podríamos decir que la IA no puede ser convocada al estrado como perito o testigo por cuanto: a) no es persona humana, b) no se la toma juramento -no sabría cómo hacerlo-, c) no aceptó el cargo ni fue designada según el ordenamiento legal vigente, d) no habría percibido los hechos -testigo- algo que es dudoso ya que podría haberlo visto y filmado, ubicado, localizado, etc., o bien, enviado mensajes e interactuado como lo hace el automóvil al pedirte que "tomes un café" al detectar cansancio o bien, que no realices una maniobra arriesgada o que te detengas.

Ante este panorama es evidente que hacer generalizaciones sería inconveniente ya que si bien pareciera que es posible rechazar de plano su presencia “autónoma” como testigo experto -o testigo al fin- si un operador presenta datos obtenidos por el uso de IA -geolocalización por ejemplo- el operador se convierte en una especie de "vocero de la IA".

Esto me lleva -otra vez- a sostener la necesidad de reconfigurar el derecho a confrontar no visto ya como la idea de tener "cara a cara" a quien aporta información en contra del acusado sino como la posibilidad de tener "cara a cara" -o de la forma que sea-, a quien ha traído esa información al juicio -datos, fotos, videos, lo que fuere- y permitir que se le pregunte cómo los generó, de dónde lo obtuvo, cuán fiable es, qué técnica utilizó, qué margen de error tiene el programa, si la técnica y software son aceptados por la comunidad científica, entre otras cuestiones relevantes.

7. ¿Qué opina la IA ante su posible citación como testigo?

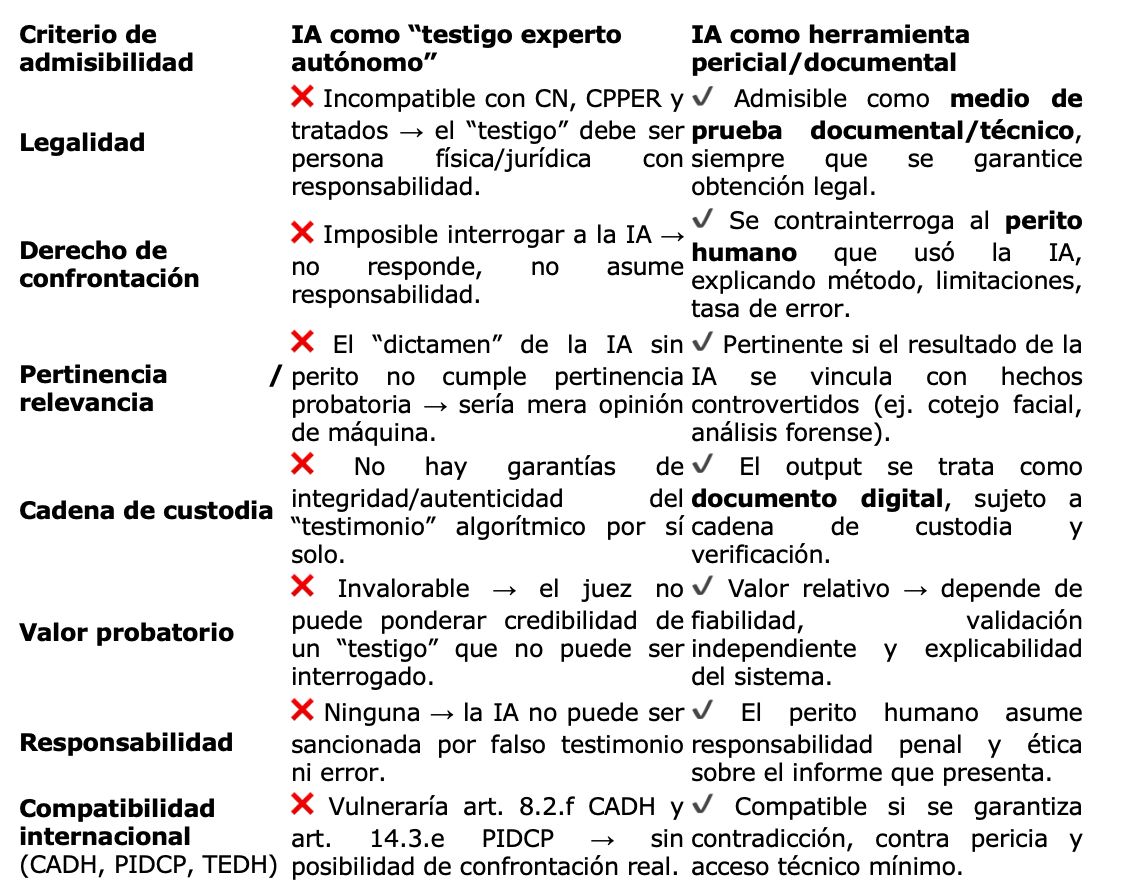

Si le preguntamos a la IA qué opina sobre su eventual citación en juicio como testigo autónomo en función de las leyes y convenciones vigentes y además, le pedimos que haga una comparación respecto de su uso como herramienta pericial / documental de la mano de un experto, esto es lo que nos dice:

8. Desarrollo de habilidades y manejo de herramientas como deber ético

Al exponer, no quise dejar pasar la oportunidad para remarcar, una vez más, la necesidad de capacitación para evitar introducir, incluso por error, información falsa al proceso. Este tema quizás no es políticamente correcto o bien, puede no resultar “taquillero” de allí que no sea parte de la agenda en ningún evento, pero es vital discutirlo[8].

La capacitación de operadores, litigantes y testigos expertos debe ser considerado un deber ético por cuanto es necesario que todos sepamos de qué estamos hablando, al menos que intentemos saberlo. Con ello, repito, la necesidad de desarrollar habilidades en esta materia es un deber ético[9].

9. Conclusión. Necesidad de recalcular el derecho a confrontar en la era de la IA

Para concluir y sin vocación de permanencia dado que es un tema que estoy investigando y en pleno desarrollo, entiendo que se debe recalcular el derecho a confrontar en función del impacto que genera el uso de la IA en el proceso penal.

A los puntos desarrollados con anterioridad debo sumarle la necesidad de generar protocolos de uso que permitan mayor transparencia y control en el uso de esta poderosa herramienta en cada una de las aplicaciones o programas que se incluya -aunque su omnipresencia complica la demarcación-.

Algunas de las pautas que propongo son: a) exigencia de códigos o protocolos que establezcan un piso mínimo de transparencia en el uso y manejo de IA, en el mientras tanto, “mentes abiertas”, racionalidad y sentido común, b) acceso de las partes a la información generada incluso al contexto a fin de evitar mutilaciones que impidan el control, c) posibilidad de validación del método, práctica, programa, etc., d) explicabilidad de las operaciones o resultados -según lo que se litigue- en lenguaje claro y sencillo en el marco del juicio, e) trazabilidad de datos y fuentes -data set-, f) exclusión de datos obtenidos por fuera de los contenedores brindados para la práctica -en caso que se solicite sólo aplicar los brindados: exclusivos- o de sitios públicos cuando se requiera una autorización legal para obtenerlos y no se obtenga en el caso concreto, g) aplicación de criterios de proporcionalidad y razonabilidad para filtrar y en su caso detener el uso indiscriminado y arbitrario de la IA cuando el caso y circunstancias así no lo requiera.

Creo que este breve listado se irá ampliando, reduciendo y/o modificando a medida que vaya viendo los problemas y soluciones que la IA trae en el ámbito del proceso penal. Con ello reitero, no pretendo escribir en piedra estas breves reflexiones.

La IA es una herramienta valiosa que esta entre nosotros no podemos mirar hacia otro lado y esperar que pase; no podemos escondernos bajo la sábana y esperar despertar en el mundo que conocíamos donde los delitos se investigaban con lupa y olfato[10].

La IA como herramienta útil debe aprovecharse, pero sin perder de vista que el humano es el centro y destinatario de toda la labor judicial y, por ende, el debido proceso como derecho humano debe marcar el límite ante cualquier intento por convertir a la IA en juez o árbitro de los conflictos más trascendentes que presenta la sociedad.

En fin, la IA no puede transformarse en la "nueva máquina de la verdad" ni el juez puede ser considerado su “vocero”. La humanidad ha sufrido el paso de herramientas de ese tipo que han pretendido convertirse en pruebas "objetivas". La inquisición y su aliada la tortura es un claro ejemplo de tiempos oscuros sobre los que no podemos volver.

Notas

[1] La admisión de prueba es un tema que me ha ocupado desde hace años centrando mi investigación en el derecho probatorio y en generar estándares de trabajo que permitan “objetivar” ciertas pautas de trabajo. Me parece bueno que hoy sea un tema debatido y discutido en diversos eventos y que la prueba ocupe el lugar que jamás debió perder en el ámbito del juicio. Ya en La Prueba en el Proceso Penal, Hammurabi, 2010, destaqué la necesidad de filtrar la prueba que se propone para juicio y formulé un Test que, aplicado al caso, brinda respuestas prácticas y coherentes a los operadores. Más adelante, propuse un Test para juicios con jueces técnicos y otro para juicios por jurados, Técnicas de Litigación Penal, Hammurabi, 2025, -5 reimpresión-, p. 75/122. Finalmente, diseñé un Test para prueba digital, La Prueba Digital, Hammurabi, 2025, -1 reimpresión-, p. 117/323.

[2] La Prueba Digital, Hammurabi, 2025, -1 reimpresión-, p. 117/323.

[3] Sobre cadena de custodia digital y uso de protocolos puede verse: La Prueba Digital, Hammurabi, 2025, -1 reimpresión-, p. 71 y ss.

[4] Ver tratamiento del tema sobre el caso “Velez Cherato”, CFCP, 28/11/23 y la posibilidad de trabajar incluso cuando se pone en duda la cadena de custodia o la omisión de seguir los protocolos, La Prueba Digital, Hammurabi, 2025, -1 reimpresión-, p. 71/87.

[5] “Frye v. United States” US 1923, sobre debido proceso y juicio justo en Estados Unidos puede verse: Técnicas de Litigación Penal, tomo IV, Hammurabi, 2021, p. 19/201.

[6] La teoría del caso debe contar con un relato claro y simple de los hechos incontrovertidos + una versión controvertida asentada en valores.

[7] El derecho a confrontar se encuentra ya en textos Bíblicos. Por mi parte, al considerarlo el motor que permite establecer o esclarecer los hechos, le he dedicado los tomos IV y V de Técnicas de Ligitación Penal.

[8] Puede verse: “El caso Ayinde”. Un fallo que nos interpela sobre responsabilidad, límites, controles de la IA en la cita de precedentes”, Hammurabi online, jurisprudencia, 23 de junio de 2025.

[9] La Prueba Digital, Hammurabi, 2025, -1 reimpresión-, p. 387/428.

[10] Lo que no quita la necesidad de ir al lugar del hecho, de entrevistar a las personas, de buscar rastros físicos que muchas veces van a complementar o permitir que el rastro digital ingrese al juicio.

* Rubén Alberto Chaia, Profesor de grado y posgrado en diversas Universidades de Argentina e invitado en Universidades extranjeras, autor de libros como: La Prueba en el Proceso Penal, (Hammurabi), Técnicas de Litigación Penal (Hammurabi, 7 tomos), La Prueba Digital (Hammurabi, 2 tomos), Responsabilidad Penal Médica (Hammurabi), La Investigación Penal (Delta), El Proceso Acusatorio (Delta), Juicio por Jurados (Abogar, 2 tomos), entre otros. Instagram: Rubén Chaia, blog: doctorRubenChaia.blog. Agradezco al doctor Hugo Perotti la invitación a disertar en este evento como también, a los organizadores, entre ellos los doctores Gaspar Recca, Fermín Bilbao y Julio Federik y a la Asociación de Profesores de Derecho Procesal Penal en la persona de su presidenta Julia Ruttigliano.

Si desea participar de nuestra «Sección Doctrina», contáctenos aquí >>